EVALUACIÓN DE SITUACIÓN

En octubre de 2016, John Podesta, director de campaña de Hillary Clinton, recibió un correo electrónico aparentemente rutinario de Google alertándole sobre un intento de acceso no autorizado a su cuenta. El mensaje incluía un enlace para «verificar la actividad de la cuenta». Podesta siguió el enlace y introdujo sus credenciales. Esta acción, aparentemente inocua, comprometió miles de correos electrónicos que posteriormente fueron filtrados, alterando potencialmente el curso de las elecciones presidenciales estadounidenses de 2016.

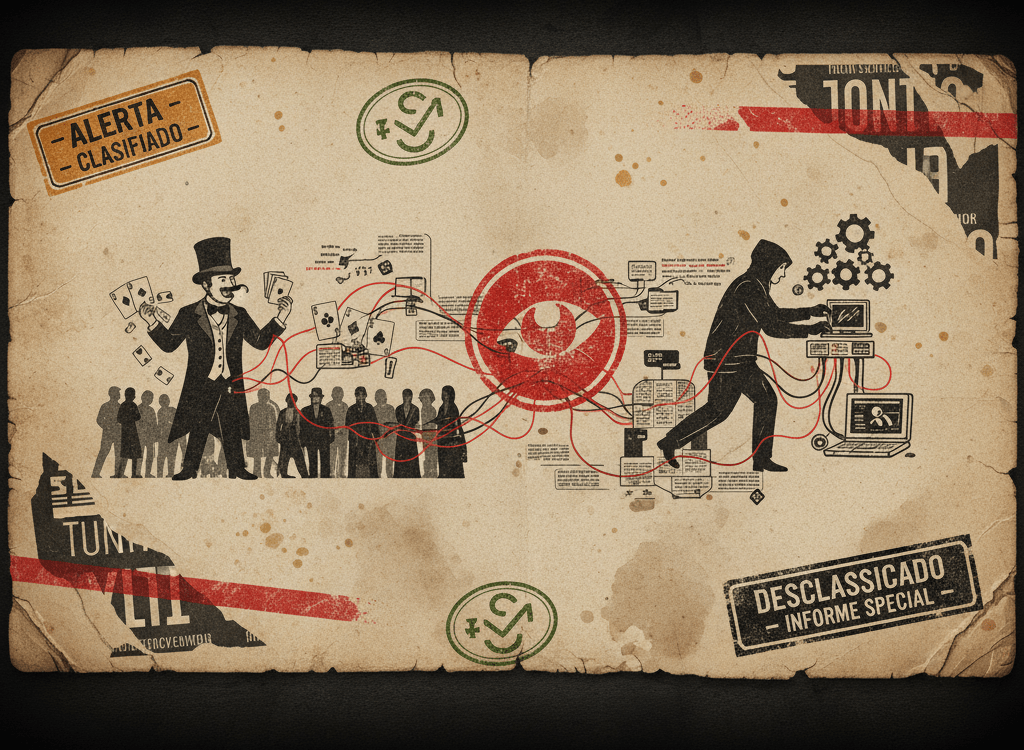

Este incidente ilustra la evolución de la historia de la ingeniería social desde los timos callejeros tradicionales hasta las sofisticadas operaciones de influencia cognitiva contemporáneas. La evidencia de fuentes abiertas indica que las técnicas fundamentales de manipulación psicológica han permanecido constantes durante siglos, pero su alcance, precisión y potencial de impacto se han amplificado exponencialmente en la era digital.

VECTOR DE AMENAZA: Análisis de la Ingeniería Social Evolutiva

La ingeniería social constituye el arte de manipular individuos para que divulguen información confidencial o ejecuten acciones que comprometan la seguridad. Según el marco teórico establecido por Robert Cialdini en «Influence: The Psychology of Persuasion» (2006), estos ataques explotan seis principios psicológicos fundamentales: reciprocidad, compromiso, prueba social, simpatía, autoridad y escasez.

El Centro de Excelencia de Comunicaciones Estratégicas de la OTAN ha documentado cómo estas técnicas clásicas se han digitalizado y militarizado. Su informe de 2017 sobre guerra cognitiva establece que «las operaciones de influencia contemporáneas combinan vectores de ataque psicológicos tradicionales con capacidades de micro-targeting algorítmico, creando una amenaza híbrida de naturaleza sin precedentes».

La evolución histórica de la ingeniería social puede categorizarse en cuatro fases operativas:

Fase I: Timos Analógicos Clásicos (1800-1950)

Los confidence tricks tradicionales establecieron los fundamentos psicológicos. El «timo del tocomocho», documentado en España desde el siglo XIX, empleaba principios de autoridad falsa y escasez temporal. Los estafadores creaban urgencia artificial («esta oportunidad no volverá a presentarse») mientras se presentaban como figuras de autoridad (banqueros, notarios).

Fase II: Ingeniería Social Telefónica (1950-1990)

La expansión de las telecomunicaciones permitió ataques remotos escalables. Kevin Mitnick, posteriormente consultor de seguridad, documentó en «The Art of Deception» (2002) cómo los atacantes explotaban la confianza institucional mediante técnicas de pretexting telefónico.

Fase III: Vectores Digitales Tempranos (1990-2010)

El correo electrónico introdujo el phishing masivo. Los primeros ataques documentados datan de mediados de los 90, dirigidos contra proveedores de servicios de Internet. La escalabilidad digital permitió ataques simultáneos contra miles de objetivos.

Fase IV: Ingeniería Social Algorítmica (2010-presente)

Las plataformas de redes sociales habilitaron spear phishing de precisión quirúrgica y operaciones de influencia masiva. El patrón operativo integra inteligencia de fuentes abiertas (OSINT) con técnicas de persuasión automatizadas.

ESTUDIO DE CASO OPERATIVO: Operaciones Documentadas

Caso 1: Operación «Fancy Bear» – Ataque al DNC (2016)

El Atlantic Council’s Digital Forensic Research Lab documentó cómo el grupo APT28, atribuido por agencias de inteligencia occidentales a la GRU rusa, empleó técnicas de ingeniería social altamente sofisticadas. La operación combinó:

- Reconnaissance OSINT: Análisis exhaustivo de perfiles públicos de objetivos.

- Spear phishing contextualizado: Correos personalizados referenciando eventos reales.

- Infraestructura de comando y control: Dominios falsificados que imitaban servicios legítimos.

- Explotación de confianza institucional: Suplantación de Google y otros proveedores.

La evidencia técnica recopilada por CrowdStrike y posteriormente validada por el FBI indica que los atacantes invirtieron meses en reconnaissance antes del ataque final.

Caso 2: Operación de Influencia «Internet Research Agency» (2014-2018)

El Stanford Internet Observatory ha documentado extensivamente las tácticas, técnicas y procedimientos (TTPs) de la Internet Research Agency. Su análisis de 2019 reveló:

- Construcción de personas artificiales: Perfiles falsos con historiales creíbles desarrollados durante años.

- Amplificación orgánica: Explotación de algoritmos de recomendación para maximizar alcance.

- Polarización dirigida: Creación de contenido diseñado para amplificar divisiones sociales existentes.

- Operaciones cross-platform: Coordinación simultánea en Facebook, Twitter, Instagram y YouTube.

Esto es consistente con las TTPs documentadas por Graphika en operaciones similares atribuidas a otros actores estatales.

PROTOCOLO DE DETECCIÓN: Indicadores de Alerta

Un indicador crítico es la presencia simultánea de múltiples señales de alarma. Los siguientes marcadores comportamentales requieren evaluación inmediata:

Indicadores Técnicos

- URLs sospechosas: Dominios que imitan servicios legítimos con variaciones tipográficas.

- Cabeceras de correo inconsistentes: Discrepancias entre remitente mostrado y cabeceras técnicas.

- Solicitudes de información fuera de protocolo: Peticiones de credenciales por canales no habituales.

- Urgencia artificial: Marcos temporales irracionales para acciones críticas.

Indicadores Psicológicos

- Explotación de autoridad: Referencias a figuras de poder sin verificación independiente.

- Reciprocidad manufacturada: Ofertas que crean sensación de deuda artificial.

- Prueba social fabricada: Claims sobre comportamiento de terceros no verificables.

- Scarcity pressure: Limitaciones temporales que impiden deliberación racional.

Indicadores Contextuales

- Momento del ataque: Comunicaciones durante eventos críticos (elecciones, crisis).

- Targeting anómalo: Contacto inesperado de organizaciones no relacionadas.

- Inconsistencias narrativas: Detalles que no encajan con procesos organizacionales estándar.

MARCO DEFENSIVO: Estrategias de Resiliencia Cognitiva

Nivel Individual: Higiene Cognitiva

- Implementar verificación dual: Confirmar solicitudes críticas por canal independiente.

- Establecer protocolos de pausa: Tiempo obligatorio de reflexión antes de acciones irreversibles.

- Desarrollar escepticismo calibrado: Cuestionar comunicaciones no solicitadas sin paranoia paralizante.

- Mantener awareness situacional: Conocimiento del contexto geopolítico y amenazas activas.

Nivel Organizacional: Protocolos Institucionales

Las organizaciones deben implementar marcos de defensa en profundidad según las recomendaciones del NIST Cybersecurity Framework:

- Formación continuada: Programas de awareness que incluyan simulacros regulares.

- Políticas de verificación: Procedimientos obligatorios para validar identidades.

- Compartimentación de información: Acceso basado en principio de menor privilegio.

- Incident response procedures: Protocolos claros para reportar y gestionar ataques.

Nivel Sistémico: Políticas de Resiliencia

El EU External Action Service ha propuesto marcos de cooperación internacional que incluyen:

- Sharing de intelligence: Intercambio de TTPs entre aliados.

- Regulación de plataformas: Obligaciones de transparencia para intermediarios digitales.

- Educación mediática: Programas curriculares de literacy cognitiva.

- Attribution frameworks: Estándares internacionales para atribución de operaciones.

EVALUACIÓN: Inteligencia Central

El análisis de la historia de la ingeniería social revela cinco conclusiones clave para la defensa cognitiva:

- Continuidad psicológica: Los mecanismos fundamentales de manipulación permanecen constantes; solo cambia el medio de delivery.

- Escalabilidad digital: La tecnología ha multiplicado exponencialmente el alcance potencial de ataques individuales.

- Hibridación operativa: Los actores contemporáneos combinan técnicas tradicionales con capacidades algorítmicas avanzadas.

- Importancia de la atribución: La identificación precisa de atacantes resulta crítica para estrategias de disuasión efectivas.

- Necesidad de defensa multicapa: La resiliencia requiere intervenciones simultáneas a nivel individual, organizacional y sistémico.

La evaluación prospectiva sugiere que la próxima fase evolutiva integrará inteligencia artificial generativa con técnicas de ingeniería social tradicionales, creando operaciones de influencia de precisión y escala sin precedentes. La preparación defensiva debe anticipar esta convergencia tecnológica mediante el desarrollo de capacidades de detección automatizada y marcos de resiliencia cognitiva escalables.

La historia de la ingeniería social demuestra que la adaptación constante resulta esencial tanto para atacantes como para defensores. La ventaja estratégica corresponderá a aquellos actores capaces de combinar comprensión psicológica profunda con capacidades tecnológicas avanzadas y marcos éticos sólidos.

REFERENCIAS

- Atlantic Council Digital Forensic Research Lab (2018). «#PutinAtWar: How the Kremlin Weaponizes Information»

- Cialdini, Robert (2006). «Influence: The Psychology of Persuasion«. Harper Business

- CrowdStrike (2016). «Bears in the Midst: Intrusion into the Democratic National Committee«

- EU External Action Service (2018). «Action Plan Against Disinformation«

- Mitnick, Kevin (2002). «The Art of Deception: Controlling the Human Element of Security«. Wiley

- NATO Strategic Communications Centre of Excellence (2017). «Cognitive Security: Mitigating Emerging Threats to the Human Operating System»

- NIST (2018). «Framework for Improving Critical Infrastructure Cybersecurity v1.1«

- Stanford Internet Observatory (2019). «Repeat Offenders: Russia’s Information Operation Campaigns»